Il est des moments où un problème technique cesse d’être une affaire de spécialistes pour devenir un fait politique. En 2005, au cœur de la guerre des navigateurs, un test en apparence modeste, Acid2, contribua à rendre visible ce que beaucoup toléraient encore : la fragmentation du Web, l’abus de position dominante et le coût collectif d’une dépendance imposée. Vingt ans plus tard, l’Europe se trouve face à une épreuve d’une autre ampleur, mais peut-être de même nature. Car derrière les suites bureautiques, le cloud, les formats propriétaires ou les infrastructures numériques, se joue moins une querelle d’ingénieurs qu’un enjeu de maîtrise, de continuité, de puissance et de liberté d’action.

C’est là que se situe pour l’Europe l’épreuve concrète de sa souveraineté numérique, son Acid Test !

En 2005, au cœur de la « guerre des navigateurs », un petit collectif de designers et développeurs, réunis sous la bannière du Web Standards Project (WaSP), a trouvé une arme d’une efficacité redoutable : un simple test en ligne. Oui, un simple test : Acid2, proposé au départ par Håkon Wium Lie et codé par Ian Hickson.

Ce n’était pas un énième document technique : c’était un défi public lancé à Microsoft, dont le navigateur Internet Explorer fragmentait le Web. À l’époque, un même site pouvait s’afficher correctement dans un navigateur et se casser dans un autre, parce que chaque éditeur imposait ses propres règles d’interprétation du HTML/CSS : les langages qui structurent l’affichage des pages web..

Résultat : des coûts de développement qui explosèrent, des services inaccessibles pour une partie du public, et un Web qui se fissura. WaSP mit en action deux leviers décisifs :

- La prise de conscience du grand public : une image mal affichée, un problème visible par tous, devenu viral, légèrement humiliant pour l’éditeur, donc impossible à ignorer pour Microsoft.

- Un changement d’objectif commun: cesser d’optimiser « pour tel navigateur » et implémenter le standard, au bénéfice de tous.

En 2007, le WaSP annonce que Microsoft a enfin corrigé son navigateur : une version interne d’Internet Explorer 8 réussit Acid2, un test conçu pour montrer d’un coup d’œil, de façon compréhensible par tous, si un navigateur respecte les règles communes du Web. Ce signal n’arrive pas dans le vide : il survient à peine une semaine après la plainte antitrust déposée par Opera contre Microsoft auprès de la Commission européenne, dans une affaire qui prend précisément sa source dans la vente liée d’Internet Explorer avec Windows et, plus largement, dans la question du respect des standards du Web.

Autrement dit : sous la pression conjuguée des développeurs, des graphistes, des internautes, du WaSP, et désormais d’un front concurrentiel et réglementaire ouvert en Europe, Microsoft a dû se remettre en question. Et parce que le résultat était visible publiquement par chacun, cette remise en conformité ne pouvait plus être différée.

Pour le grand public, si le test s’affichait correctement, c’était le signe d’un navigateur plus respectueux des standards et, par conséquent, plus fidèle dans son rendu. Concrètement : moins de sites conçus pour un seul navigateur, moins de pages qui s’affichent de travers et, au bout du compte, un Web plus fiable, plus cohérent, plus accessible.

Pour les organisations européennes : une dépendance quotidienne

Vingt ans plus tard, le champ de bataille a changé : les enjeux ne sont plus des moteurs de rendu HTML, mais des suites bureautiques, du cloud, des identités numériques, des formats propriétaires, du matériel et des habitudes profondément enracinées.

La dépendance quotidienne de millions d’organisations européennes envers Microsoft ou Google notamment, n’est plus un sujet de spécialistes : c’est une infrastructure invisible qui impose ses coûts, ses contraintes et ses verrouillages, et finit par réduire notre marge de manœuvre politique et économique.

Après l’électrochoc géopolitique provoqué par l’administration Trump qui bouscule l’Europe, il devient difficile de faire comme si la question pouvait encore attendre. D’où l’angle de cet article : Souveraineté numérique : l’Europe face à son Acid Test

Mais cette fois, le test n’est pas une page web affichant un smiley 🙂 pour confirmer que tout fonctionne. Cette fois, c’est notre capacité collective à sortir d’une dépendance ignorée, niée ou résignée.

Sensibiliser le grand public et se protéger d’un Big Shift

Et comme en 2005, il y a probablement deux leviers à actionner pour que ça bouge vraiment.

D’abord, sensibiliser le grand public, non par une conférence d’initiés et d’experts, mais par des messages compréhensibles par tous et faciles à vérifier.

Expliquer pourquoi il est devenu si difficile de bâtir une souveraineté numérique en France et en Europe : coûts, verrouillage, exposition juridique, continuité d’activité, lobbying, pantouflage, soupçons de corruption, inculture numérique des responsables politiques, capacité à décider.

Montrer comment la dépendance s’installe, et ce qu’elle nous retire, jour après jour, sans bruit.

Ensuite, proposer un chemin de sortie lisible : quoi migrer, vers quoi, dans quel ordre, avec quelles garanties et quels gains concrets, pour que les entreprises, les administrations, les citoyens et les divers écosystèmes puissent faire de vrais choix, sans se mettre en danger et en se protégeant d’un Big Shift.

Parce qu’au fond, cet « Acid Test » européen, que nous sommes en train de vivre, teste notre capacité commune à transformer un sujet abstrait en évidence partagée, puis en plan d’action concret.

Soyons lucides : si l’Europe échoue à convertir ce moment historique en bifurcation rapide et ambitieuse, il se pourrait que ce soit, pour longtemps, la dernière fenêtre où l’histoire nous autorise encore à choisir.

Un enjeu fort : prendre des décisions visibles

Attention au piège bien connu des discours européens : celui des diagnostics impeccables et des plans qui s’empilent sans basculer dans le réel. L’enjeu n’est plus d’accepter la dépendance numérique en se résignant, mais de la réduire activement par des décisions visibles : continuité d’activité, coûts, sécurité, capacité à décider, détermination assumée, via des actes concrets et un horizon clair pour un retour de l’Europe dans la nouvelle industrie… tout doit converger vers un même objectif de visibilité et de lisibilité des actions.

Rappelons que des signaux d’alerte existaient déjà : en 2023, Tariq Krim tranchait avec une formule volontairement brutale : La souveraineté numérique est morte… Vive la résilience !, comme un avertissement : sans vision claire, concrète et robuste, l’Europe se condamne à gérer l’urgence plutôt qu’à choisir sa trajectoire.

Le décor est planté, le reste ne se joue plus dans les intentions, mais dans la compréhension de la mécanique. La souveraineté numérique n’est pas un concept abstrait : elle se mesure à une accumulation de dépendances concrètes, parfois discrètes, souvent routinières, mais toujours lourde de conséquences quand elle se referme comme un étau.

7 mécanismes qui freinent l’autonomie stratégique et numérique

J’ai identifié et regroupé les principaux freins à partir de sources disponibles par tous, en les synthétisant dans une grille de lecture consolidée. Cette synthèse citoyenne n’a pas prétention à être parfaite ni exhaustive : elle reflète un état de compréhension à un instant donné, avec ses limites, ses biais inévitables et des zones où l’information publique reste incomplète.

J’invite donc explicitement les acteurs du secteur, les administrations, les experts, les entreprises et tous les défenseurs de la souveraineté numérique à me corriger, me contredire ou me compléter si certains constats sont mal interprétés, insuffisamment étayés ou si des éléments importants m’ont échappé. Pour rendre l’analyse lisible, j’ai découpé ces difficultés en sept grandes catégories, chacune accompagnée d’une explication simple illustrant, point par point, comment ces mécanismes freinent l’autonomie stratégique et numérique.

1. Gouvernance, doctrine et exécution de l’État

Sans direction claire (qui décide, avec quels objectifs, et à quel rythme ?), les administrations avancent en ordre dispersé. La souveraineté numérique exige une exécution continue sur plusieurs années, pas seulement des annonces :

- Pas de cap national clair sur le numérique et ses risques géopolitiques :

Sans doctrine stable et de stratégie à long terme, ce qu’on accepte, ce qu’on refuse, et pourquoi, alors les choix techniques se font par défaut et s’accumulent sans cohérence. - Pas de plan de secours crédible quand ça casse : panne, crise, sanctions, rupture :

La souveraineté n’est réelle que si les services essentiels peuvent continuer à fonctionner en mode dégradé. Sinon, nous obtenons une souveraineté de façade, qui s’effondrerait à la première crise. - Cybersécurité : ambitions affichées, moyens et calendrier fragiles :

Une stratégie cyber sans financement lisible et sans calendrier tenable devient un document de communication, pas un bouclier. Les retards réglementaires laissent les organisations seules face à des obligations qui arrivent trop tard. - Trop d’instances, labels et « observatoires » : beaucoup de pilotage, peu de résultats :

Multiplier les structures dilue la responsabilité et ralentit l’action. Les citoyens et les entreprises voient passer des logos, des slogans, des conférences et des communiqués de presse mais pas des services qui changent concrètement. - Politiques, administrations et industriels reconnaissent le problème, mais les décisions concrètes sont constamment repoussées :

Les mesures utiles demandent des arbitrages visibles : budget, formation, migration, donc un risque politique à court terme. Résultat : on repousse, on temporise, on optimise le statu quo.

2. Dynamiques de marché et intermédiation : ESN, partenaires, compétences

Même avec une bonne volonté politique, le marché pousse naturellement vers les solutions dominantes : compétences disponibles, habitudes, « personne ne se fait virer pour ça ». Comprendre ces incitations est indispensable pour les corriger.

- Les prestataires poussent ce qu’ils savent vendre et opérer :

Quand une ESN est formée, outillée et « récompensée » via des témoignages clients, ou autres participation à des tables rondes, spécialement bien conçus par les #GAFAM ou autres acteurs de la Big Tech US, elle les recommande plus souvent, même si une alternative ferait mieux sur le long terme. - Les compétences se concentrent sur quelques marques, pas sur des savoir-faire transférables :

On construit des carrières autour de certifications, souvent délivrées par la Big Tech, ce qui rend les alternatives plus difficiles à doter en compétences et donc moins souvent choisies. À terme, ça appauvrit la capacité collective à changer de fournisseur. - La commande publique ne crée pas assez de marché pour les alternatives :

Sans commandes massives, les acteurs européens n’atteignent pas l’échelle, donc restent « petits », donc restent jugés « risqués » : cercle vicieux.

3. Verrouillage technico-économique et dépendances structurelles

La dépendance n’est pas qu’un choix politique : elle est comme « encodée » dans les outils : formats, API, licences, habitudes. Plus on attend assumer des risques et mettre en place des alternatives, plus sortir des dépendances coûte cher.

- Changer de fournisseur devient trop cher et trop long :

Avec le temps, s’accumulent des formats, des automatisations, des habitudes et des engagements contractuels qui rendent toute sortie longue, coûteuse et délicate. On reste captif, même quand la volonté de changer est là. - Des dépendances invisibles : OS, firmwares, télémétrie, licences :

On peut héberger « en Europe » tout en dépendant d’éléments critiques : logiciels, mises à jour, licences, lois extraterritoriales, contrôlés ailleurs. Ce sont des dépendances difficiles à expliquer au grand public, donc souvent ignorées. - Pas d’alternative bureautique « simple et complète » à grande échelle :

Tant qu’il n’existe pas une suite réellement déployable partout : support, compatibilité, formation, la dépendance à Microsoft/Google reste mécaniquement forte. - Pour les citoyens, migrer est pénible (et le support manque) :

Si la transition demande trop d’efforts (changer d’habitudes, formats, outils, prix), la majorité ne suit pas, donc pas d’effet de masse. Or sans masse, pas d’écosystème.

4. Normes, certifications et cadres juridiques

Les règles peuvent protéger, mais elles peuvent aussi exclure ou ralentir si elles deviennent trop lourdes. L’enjeu est d’avoir des règles qui sécurisent et permettent à une offre européenne de grandir.

- SecNumCloud : une certification de sécurité qui, aujourd’hui, peut aussi décider « qui a le droit de jouer » sur le marché du cloud souverain :

SecNumCloud reste un référentiel de sécurité très exigeant, mais la qualification SecNumCloud 3.2 de S3NS (Thales + technologie Google 🤡) montre qu’il peut aussi devenir un mécanisme de réorganisation du marché : les acteurs capables de porter un montage industriel/juridique lourd (et d’absorber le coût de qualification) prennent mécaniquement l’avantage, y compris quand la technologie sous-jacente n’est pas européenne.

En parallèle, au niveau européen, la trajectoire de l’EUCS (telle que rapportée) s’oriente vers une certification surtout « cybersécurité » sans critères de souveraineté juridique, ce qui risque de diluer l’avantage différenciant de SecNumCloud et de faciliter une légitimation « cloud de confiance » d’acteurs soumis à des lois extraterritoriales, au détriment des acteurs qui avaient investi dans une souveraineté plus stricte.

5. Écosystème d’innovation, culture et financement

Une politique d’innovation peut fabriquer… de la dépendance, si elle finance des entreprises construites sur des briques étrangères sans exigence de réversibilité. La souveraineté demande des critères simples dans les aides : où sont les données ? quelles dépendances ? et comment sortir ?

- L’argent public aide parfois des modèles… dépendants des Big Tech :

Sans conditions minimales (réversibilité, alternatives, transparence), une partie des subventions finit indirectement dans les plateformes dominantes : cloud, IA, outils. - « Syndrome de Stockholm » : on finit par admirer ce dont on dépend :

Quand l’écosystème valorise « être compatible GAFAM » comme signe de modernité, on normalise la dépendance. Et on stigmatise l’alternative comme « idéologique » ou « solutions d’amateurs ». - L’État n’est pas exemplaire dans ses propres choix :

Quand l’État ou des plateformes publiques utilisent des solutions controversées, il envoie le message que « c’est acceptable », donc il fragilise la crédibilité du discours souverain.

6. Infrastructures critiques, IA et dépendance capacitaire

La souveraineté se joue aussi sur la capacité matérielle et industrielle : puces, centres de données, puissance de calcul, solutions cloud. Sans capacité, on dépend des conditions et des prix fixés ailleurs.

- IA : dépendance au calcul, aux modèles et aux plateformes :

Si l’Europe ne dispose pas d’assez de capacité de calcul et de services numériques majeurs, elle se retrouve à payer durablement une « rente » à des acteurs étrangers et à subir leurs règles. Cela concerne autant les entreprises que les administrations donc aussi les citoyens : une part (trop) importante de la valeur technologique, intellectuelle, industrielle et financière est alors captée hors d’Europe, au lieu de renforcer notre autonomie stratégique.

7. Capture, conflits d’intérêts et coût de la prise de risque

Même une bonne politique peut être neutralisée si les règles sont écrites par/pour les plus puissants, ou si les décideurs et les acteurs privés ont des intérêts trop alignés. Et si entreprendre est jugé « trop risqué », personne ne tente l’alternative.

- Pantouflage : va-et-vient public/privé qui brouille l’intérêt général :

Quand des décideurs ou ex-décideurs rejoignent des acteurs concernés, cela crée (au minimum) un soupçon d’alignement d’intérêts. Ce soupçon suffit à dégrader la confiance et à orienter les politiques. - Capture réglementaire : des règles qui « trient » les gagnants :

Quand la conformité devient un parcours long et cher, seuls quelques acteurs peuvent jouer et les autres sortent du marché. La souveraineté devient alors un marché fermé, pas un écosystème vivant. - Le risque et surtout le coût de « l’échec » est trop élevé :

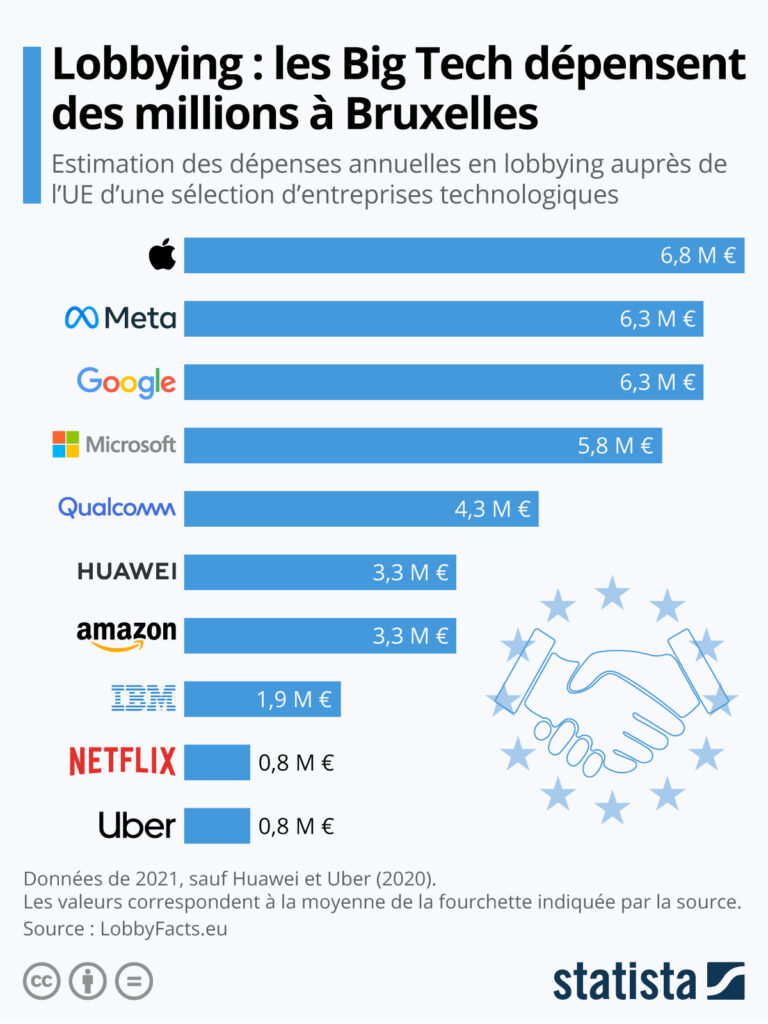

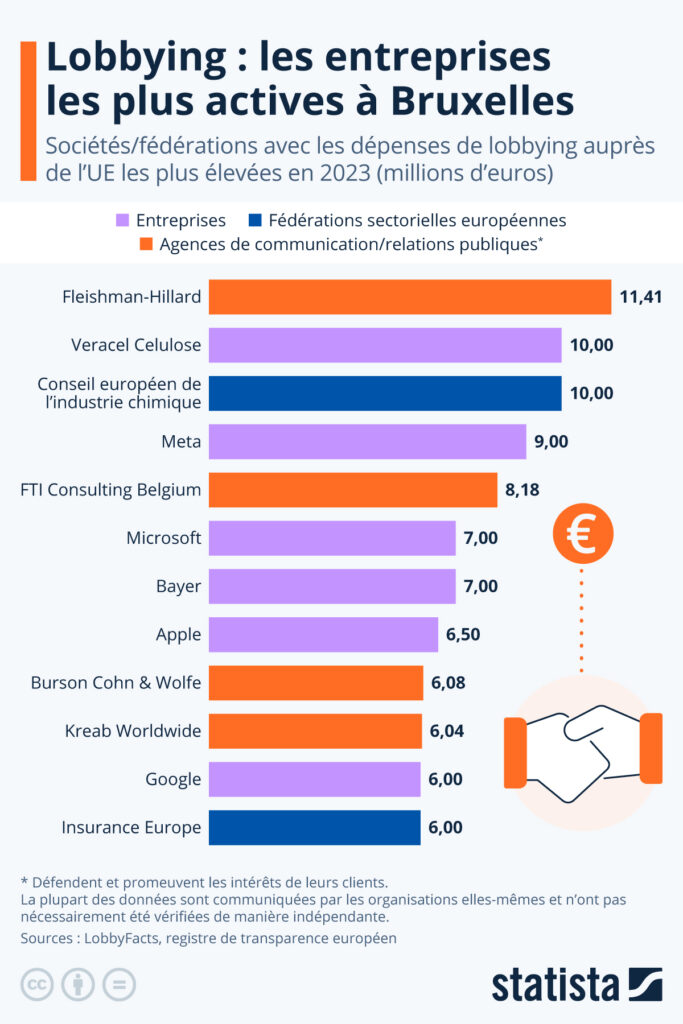

Si les entreprises craignent plus l’échec et surtout ses coûts, que la dépendance, elles choisissent la voie la plus « sûre » : le standard « dominant le marché ». La souveraineté exige que prendre un risque raisonnable soit possible : financement, marché, droit du travail, commandes. - Lobbying : compromis politiques qui favorisent des solutions « US sous emballage » :

Quand le lobbying est massif, les textes finissent souvent par privilégier la « compatibilité marché » plutôt que l’autonomie réelle.

Résultat : on régule… sans changer la dépendance.

Cette analyse procède d’une veille engagée depuis plusieurs années. Mais depuis 2025, elle s’est prolongée par un travail de curation de plus de 180 sources distinctes, sélectionnées pour leur intérêt et leur valeur d’éclairage : articles, rapports officiels, tribunes et études… Chaque argument et exemple présenté ici est le résultat d’une synthèse rigoureuse, alimentée par des sources variées et régulièrement mises à jour. Pour des raisons de lisibilité, il n’est pas possible d’intégrer une référence à chaque affirmation dans le texte. Cependant, l’intégralité des sources est accessible gratuitement pour celles et ceux qui souhaitent approfondir, vérifier ou explorer les documents originaux. Vous pouvez consulter l’ensemble de cette base documentaire, organisée et actualisée, sur mon espace de veille Flus.

Construire un récit compréhensible

On ne gagne pas en autonomie par décret. En revanche, il existe un champ immense des possibles, des voies techniques, juridiques, industrielles, éducatives, des scénarios graduels, des bifurcations réalistes. L’Europe ne manque pas d’intelligence et d’innovation. Elle manque d’une bascule. Et d’un signal collectif.

Ma conviction, forgée par des années de veille, est simple, mais pas simpliste : les professionnels et les acteurs du secteur constatent tous les jours les dépendances, les blocages, les angles morts, les budgets se faire siphonner en dehors de l’Europe, les compromis, les chaînes d’approvisionnement invisibles. Ce qui manque maintenant, ce n’est pas la lucidité dans les cercles techniques et d’experts, c’est sa traduction en décisions, puis en mouvement de masse.

Du côté politique, l’image est nettement plus trouble, pour utiliser un terme mesuré. Quelques élus s’en saisissent, pas toujours ceux qui tiennent les leviers, les budgets, les arbitrages, ni la capacité d’imposer une trajectoire sur dix ans. Et du côté du grand public, le sujet reste trop discret, trop abstrait, trop souvent relégué au rang d’inquiétude d’initiés. Or c’est précisément là que se joue l’issue : tant que la souveraineté numérique restera un langage réservé aux experts, elle restera une variable d’ajustement.

Source : Forum de Paris sur la paix

À l’inverse, le jour où notre dépendance devient une évidence partagée, elle peut se transformer en pression publique et démocratique. Le jour où citoyens, clients/utilisateurs finaux, collectivités comprennent, alors les décideurs n’ont plus l’alibi de l’ignorance, ni le confort du « flou« , « c’est trop compliqué« , « on n’y comprend rien », « de toute façon on achètera la techno aux Chinois ou ailleurs« .

En résumé, au moment où l’Europe affronte son Acid Test, elle ne passe pas seulement un test technique mais aussi et surtout un test de maturité collective. Rappelons-nous : dans la guerre des navigateurs, l’étincelle n’a pas été une commission interminable, mais une initiative concrète, lisible et virale. Au départ, ils n’étaient que trois : Maria Olsen, Glenn Davis, Jeffrey Zeldman et l’évidence a fini par faire plier un géant comme Microsoft.

Certes, je ne prétends pas que la souveraineté numérique réduit à une liste de critères : le monde d’aujourd’hui est plus vaste, plus systémique, plus complexe, plus politique voire même plus géopolitique. Mais je soutiens ceci : il faut, maintenant, parler autrement. Parler au-delà de nos cercles respectifs. Construire un récit compréhensible, des repères concrets, des signaux simples, des priorités assumées. Si le public ne comprend pas, il n’adhère pas, s’il n’adhère pas, il ne demande rien et s’il ne demande rien, alors rien ne bouge.

Des exemples inspirants en France et en Europe

Et pourtant, nous avons déjà su, en France, innover et faire muter des usages. Avant même que le mot « souveraineté numérique » ne s’impose, nous avions des services qui tenaient la comparaison : Dailymotion n’avait pas à rougir face à YouTube ; Caramail, avec ses lourdeurs et son Java à télécharger, déjà d’un autre âge, a pourtant été un des premiers réseaux sociaux avant l’heure. Mais ces exemples disent aussi autre chose : si le public peut adopter des alternatives locales ou européennes, celles-ci peinent à tenir dans la durée face à des géants mieux armés. Dailymotion a fini marginalisé puis contraint de se repositionner, Caramail a été vendu, dépecé, et n’a jamais retrouvé sa base d’utilisateurs. La leçon est donc plus exigeante que le simple constat d’une adhésion possible : le public n’est pas hostile « par nature » aux alternatives locales ou européennes, mais cette adhésion ne suffit pas. Il adopte ce qui est simple, fiable, désirable, soutenu et il faut précisément un soutien structurel pour que l’offre tienne, dure, et puisse réellement aller chercher une adoption de masse.

Et bien sûr, l’Europe n’est pas un désert. Elle compte des réussites et des leaders : Spotify, Leboncoin, BlaBlaCar, Deezer, Doctolib, Ledger, OVH, Back Market, Clever Cloud, Scaleway, Revolut, Heetch, Criteo et bien d’autres que j’oublie et j’espère qu’ils me pardonneront.

Briser la chaîne de dépendance

Mais la lucidité impose de nommer les manques : une messagerie et une suite bureautique « sans douleur » à l’échelle ; un réseau social européen digne de confiance ; un moteur de recherche crédible ; un concurrent logistique et marchand capable d’atteindre la masse critique et, en parallèle, une couche matérielle enfin reprise en main : puces, serveurs, équipements réseaux, terminaux. Car la chaîne de dépendance commence là, dans le silicium, les firmwares et les chaînes d’approvisionnement. Sans capacité industrielle, aucune souveraineté ne tient.

Sans ces piliers, la dépendance restera mécanique, et l’IA européenne comme Mistral et les autres, manquera durablement d’assise : données, infrastructures, capacités de calcul, briques matérielles maîtrisées, accords clairs avec les éditeurs et créateurs, conditions d’entraînement compatibles avec le droit européen. À cela s’ajoute une autre condition, souvent sous-estimée mais décisive : la capacité à bâtir une offre publicitaire concurrentielle et sainement régulée : éthique, fondée sur le consentement, conforme au RGPD et transparente, donc plus saine, plus soutenable et, in fine, plus valorisante pour les annonceurs.

Pacifier l’usage du terme « souveraineté numérique »

La souveraineté numérique n’est pas une mode passagère ni un énième concept bobo. Ce n’est ni un luxe, ni un hobby de spécialistes, ni une posture sociale. C’est un sujet d’intérêt général et c’est une nécessité : continuité des services, résilience économique, autonomie démocratique et stratégique, capacité industrielle, protection des libertés. Ce n’est ni de droite ni de gauche : c’est un commun. Et si certains préfèrent utiliser le terme autonomie stratégique, je peux comprendre mais nous n’avons pas à avoir honte de l’expression souveraineté numérique. À ne pas la confondre avec le souverainisme. Assumons le terme, et faisons en sorte qu’il appartienne à tout le monde, précisément parce qu’il concerne tout le monde.

Reste enfin une exigence morale et pratique : l’union. Il est temps que celles et ceux qui croient au concept de souveraineté numérique, cessent de reproduire les travers des partis, des « chapelles », des guerres d’ego. Ce projet est immense. Il y a de la place, mais il y a surtout une urgence. Mettons-nous autour de la table, échangeons, construisons des compromis, fixons des intérêts communs dès le départ, assez clairs pour dépasser les intérêts personnels, assez solides pour survivre aux alternances, assez concrets pour produire des résultats visibles par tous. Car pendant que nous nous divisons, ce sont les GAFAM qui gagnent, tranquillement, mécaniquement, par notre inertie.

Le problème, c’est qu’aujourd’hui, on a des hommes politiques qui délèguent trop de choses aux GAFAM. Parfois, ils délèguent aux plateformes de réseaux sociaux la modération. Ils délèguent aux créateurs de modèles d’IA l’éthique de l’intelligence artificielle, avec, vous le voyez, un pantouflage assez incroyable.

Et si vous voulez, à partir de là, vous entrez dans cette logique de soumission et de servitude, parce qu’en plus, vous déléguez là où, normalement, il faudrait contrôler.

Je ne suis pas forcément pour que l’Europe soit uniquement dans une position de contrôle. On doit revenir dans une logique de puissance.

Propos de Mehdi Medjaoui fondateur d’Olympe Legal via la chaîne Youtube de Yassine Chabli.

L’Europe ne réussira pas son Acid Test à coups d’incantations. Elle pourra l’aborder plus lucidement lorsque le public demandera à ses élus, avec clarté, de répondre à des enjeux désormais mieux compris et davantage débattus. Encore faut-il que les acteurs, en agissant de manière concertée, rendent ce choix réellement possible.

Alors, la souveraineté numérique pourra commencer à sortir du registre du slogan pour s’inscrire dans une démarche plus concrète.

Une trajectoire européenne originale pourra ainsi se dessiner, dans un esprit de construction plutôt que de rupture, c’est-à-dire comme une orientation politique construite, assumée et consolidée dans le temps.

Remerciements à Christophe Castro pour sa relecture et ses conseils éditoriaux.

Laisser un commentaire